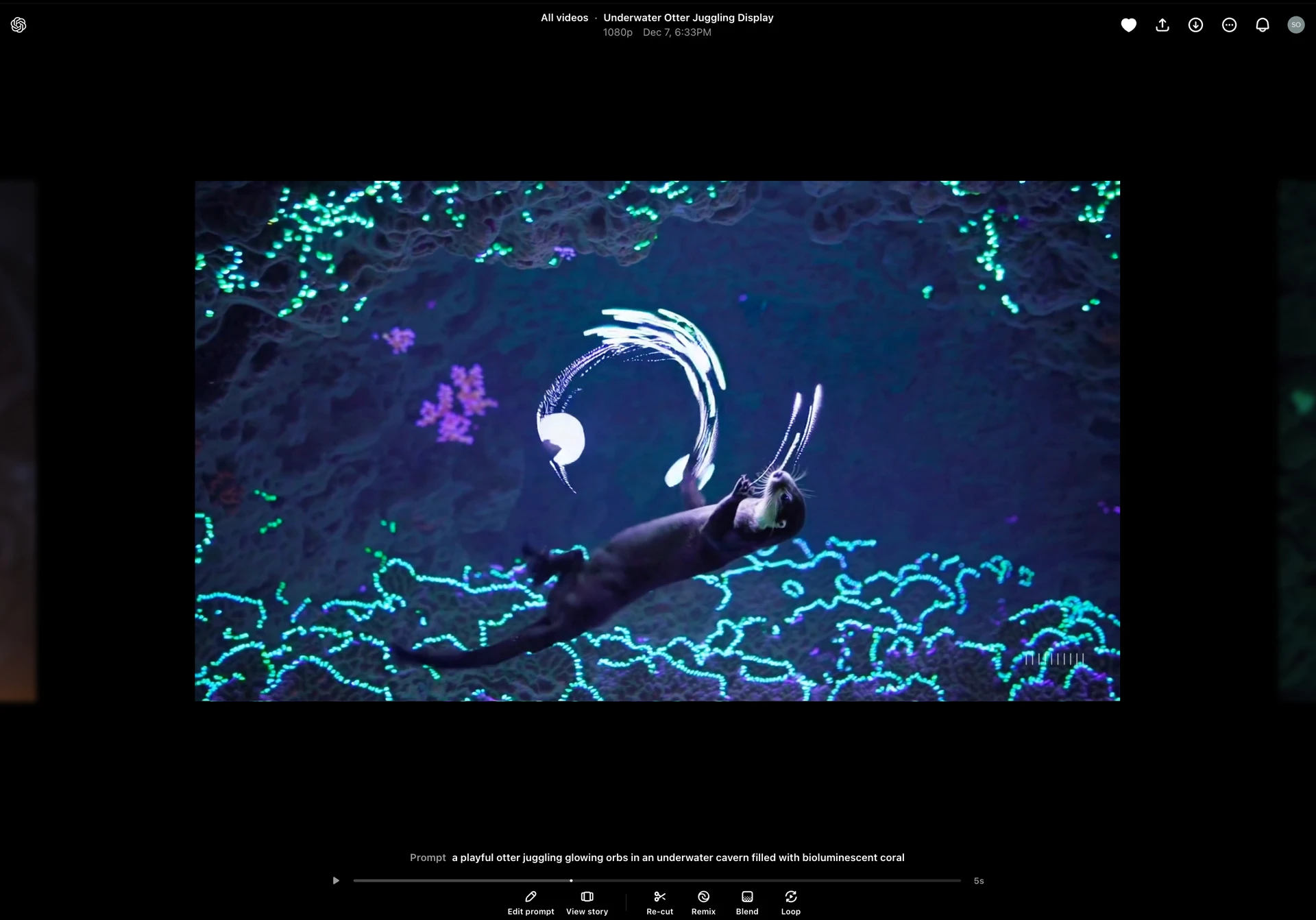

Em fevereiro passado, a OpenAI lançou um poderoso gerador de IA chamado Sora, que poderia criar vídeos completos a partir de simples instruções de texto. Hoje, Sora sai do beta e está lançando para o público.

Disponível como parte das assinaturas do ChatGPT a partir de US$ 20/mês, os usuários poderão criar vídeos de alta definição com até 20 segundos de duração a partir de nada mais do que um prompt de texto. No entanto, as capacidades e a UX do Sora estão muito além da apresentação espartana do ChatGPT.

Mais notavelmente, um pequeno grupo de testadores piloto será capaz de fazer upload de imagens de pessoas para colocar humanos reais em cenas imaginárias (um recurso que a OpenAI diz que pode ou não liberar para todo o público).

“Estamos realizando o experimento por um determinado período de tempo antes de tomarmos a decisão”, diz Rohan Sahai, líder de produto da Sora.

Por dentro do design de Sora

O que mais me surpreendeu em minha demonstração remota do Sora foi simplesmente o quão articulada a interface inicial parece ser – e quão mais rica é toda a sua abordagem à UX em comparação com o lançamento do ChatGPT alguns anos atrás. A empresa está encontrando um equilíbrio entre um fluxo de trabalho de IA poderoso e personalizável e algo simples o suficiente para ser entendido por uma pessoa comum.

“Precisávamos adicionar novas interfaces”, diz Souki Mansoor, artista líder do programa Sora.

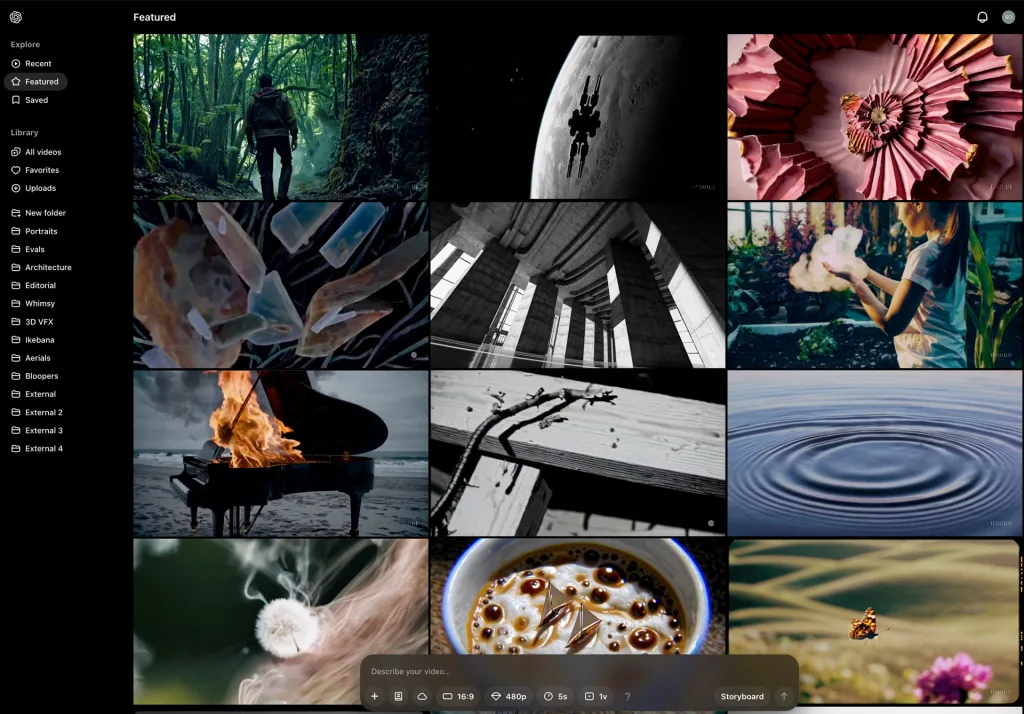

A caixa de prompt é apenas uma das poucas opções para gerar vídeos. Você também pode importar sua própria mídia de inspiração e até treinar sua própria estética estilizada. A interface recebe você em um sistema de gerenciamento de arquivos que pode sair diretamente do Google Drive. Você tem um diretório de projetos à esquerda e seu espaço de trabalho à direita.

No topo da lista está um feed, que inclui trabalhos recentes da comunidade Sora, apresentados como um painel de humor estóico que lembra repositórios de design visual. “Estávamos pensando nisso menos como um feed de mídia social do que como inspiração e educação, para ajudar as pessoas a saberem como usar o Sora de maneiras mais eficazes”, diz Mansoor. Toque em qualquer um desses vídeos e você poderá não apenas assisti-lo, mas também ver as instruções e métodos por trás dele, e pode até remixar esse vídeo (como o AI TikTok), se desejar.

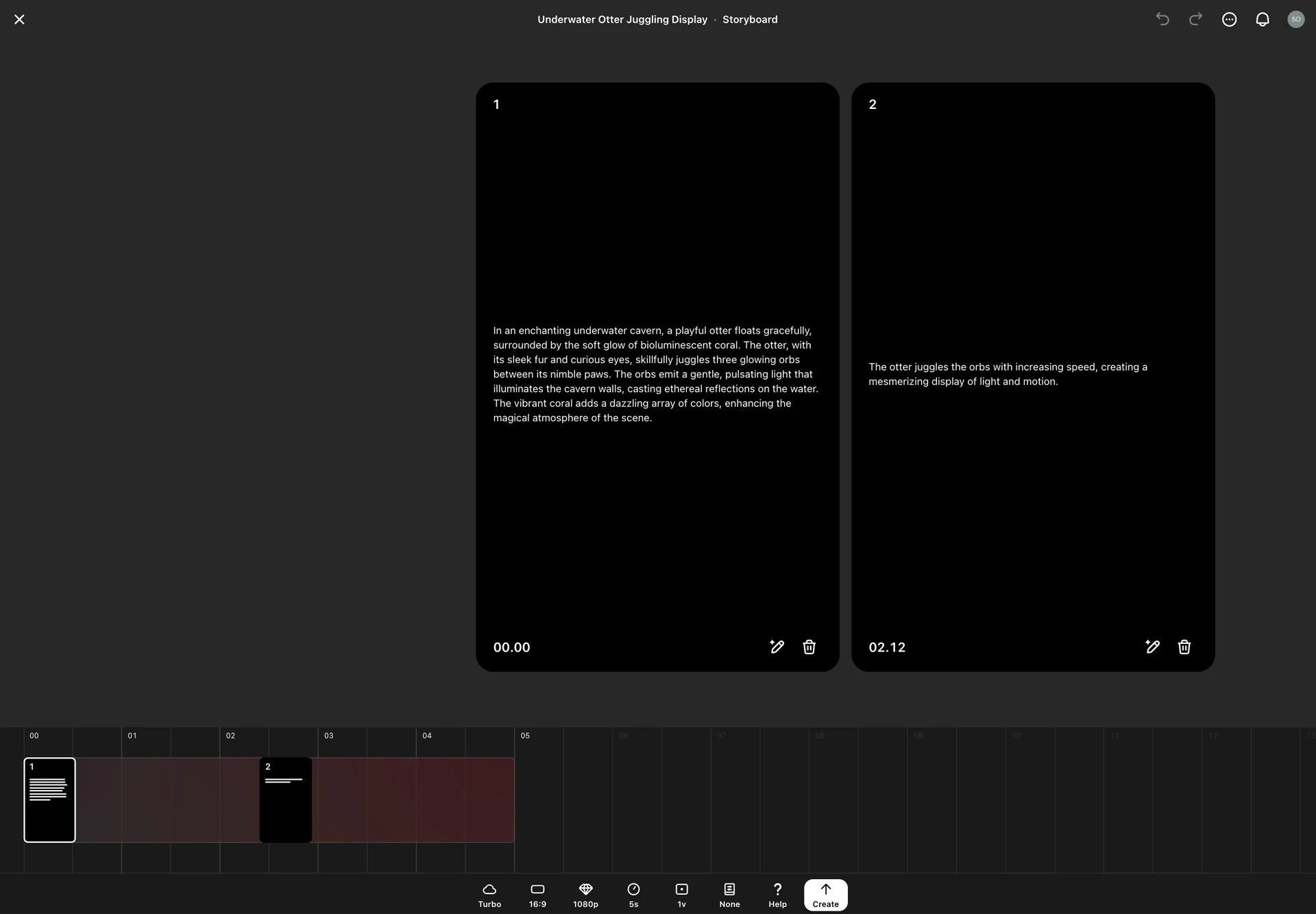

Mas quando você realmente começa a criar seus próprios vídeos, o conjunto maior de ferramentas se parece com Adobe Premiere ou iMovie. No momento em que você começa a gerar um vídeo, você pode acessar a visualização da linha do tempo, onde Sora descreve o que está gerando para você em um storyboard de cartões de texto.

Como Sora funciona

Encarreguei a equipe de gerar um axolote na praia. Mesmo neste storyboard inicial, posso ver como a OpenAI enriqueceu meu prompt de texto para garantir que tenho um vídeo que vale a pena assistir, descrevendo o animal como rosa com “brânquias emplumadas distintas” com “ondas suaves batendo enquanto brilham”. No próximo painel do storyboard, aprendo o que o axolote está fazendo, já que não lhe dei nenhuma tarefa. Ele “se move ligeiramente”, com guelras esvoaçantes enquanto olha em direção ao oceano.

Eu poderia entrar nesses storyboards para reescrevê-los. Ou eu poderia pular para uma barra de navegação inferior para alterar a resolução ou adicionar um filtro estilístico de minha própria criação treinada, como filme noir. Quando pergunto quanta energia cada um desses vídeos leva para gerar, a OpenAI oferece o equivalente a um “sem comentários”.

O axolote que comprei tinha muitas guelras, mas fora isso era um vídeo natural convincente. Em seguida, a equipe demonstrou suas outras ferramentas de linha do tempo de vídeo, como misturar duas cenas, alongar o vídeo para ficar mais longo ou experimentar outro clipe para inspirar sua própria estética.

Esses recursos foram desenvolvidos no último ano em uma versão beta fechada que a OpenAI vem executando com criativos de todo o mundo. Um desses grupos foi o grupo musical canadense Shy Kids, que produziu um vídeo genuinamente afetivo para seu último single, “My Love”, no qual dois macacos se deleitam em sua companhia em uma floresta tropical intocada. . . antes de uma triste revelação. É exatamente o tipo de imagem que você poderia passar a vida inteira perseguindo como fotógrafo de vida selvagem e nunca testemunhar. Mas Shy Kids produziu o vídeo praticamente em duas semanas, sem nenhum efeito visual fora de Sora, além de edição de luz e correção de cores.

“É muito bom para garantir que nunca haja uma página em branco. Ele permite que você idealize e itere rapidamente, o que permite que mais pessoas participem do processo criativo”, escreve o membro do grupo Walter Woodman por e-mail. “Ainda precisa de trabalho na especificidade. Dito isto, você não fica chateado com uma criança por não ser capaz de entender física. . . ainda!

“Nosso plano é continuar a explorar seus limites. . . e não”, continua ele. “Atualmente estou em Marrakech, o cara que carrega uma câmera analógica de 5 quilos e um filme porque é muito importante fazer imagens à moda antiga. Dito isto, também é extremamente importante explorar e moldar o novo.”

Teste de estresse do sistema e decisão do futuro dos deepfakes

Embora a OpenAI tenha trabalhado com artistas no ano passado, a empresa realmente viveu duas vidas. “Os artistas não são usuários maliciosos”, observa Sahai. Portanto, para testar o sistema, a OpenAI recorre aos seus “equipes vermelhos”, que tentam erradicar todos os casos de uso terríveis antes que o público possa fazê-lo.

OpenAI descreve as proteções por trás do Sora como sua “pilha de segurança”. Muito disso simplesmente se baseia em todo o trabalho que a OpenAI já fez com o ChatGPT e seu gerador de imagens Dall-E. A análise de linguagem ChatGPT analisa cada solicitação. Não é possível, por exemplo, gerar nudez ou imagens violentas no Dall-E hoje.

O seu objetivo é “equilibrar a criatividade e o uso indevido”, diz Sahai. “Estamos começando com uma abordagem bastante cautelosa. Queremos ser extremamente conservadores em relação a qualquer coisa no domínio do abuso sexual infantil, ou deepfakes de pornografia de vingança, (para que estes) casos de uso se tornem essencialmente impossíveis em Sora. Espero que muitos criativos digam que é um pouco feliz com as recusas, e descobriremos esse equilíbrio ao longo do tempo.

Fui o primeiro jornalista a entrevistar o desenvolvedor anônimo por trás do método deepfake original em 2018 e, embora o trabalho fosse em grande parte trabalhoso e bruto, ficou claro que havíamos entrado em um novo capítulo radical na humanidade, quando qualquer pessoa poderia ser transformada em qualquer contexto mais ou menos instantaneamente. Seis anos depois, Sora nos trouxe para esse futuro.

A opção mais fácil para mitigar o pior abuso com Sora seria garantir que nenhum ser humano reconhecível pudesse ser gerado dentro dele. No entanto, como explica a equipe, muitos artistas manifestaram interesse em inserir pessoas específicas em cenas a partir de imagens de amostra – e para ser justo, qualquer pessoa na produção criativa poderia realmente usar tal ferramenta.

“Eu venho de uma experiência em cinema. . . então (eu entendo querer) que Sora apoie vídeos que incluam pessoas reais”, diz Mansoor. “Queremos evitar o uso indevido.”

Então, quais são os limitadores do uso indevido? OpenAI está lançando a geração humana por meio do beta limitado mencionado acima. É promissor que moderadores humanos estudem os resultados de perto, e o uso de rostos de celebridades e figuras públicas será bloqueado por padrão. Todos os vídeos produzidos têm marca d’água invisível para procedência rastreável. Eles também banirão qualquer coisa que se transforme em um “padrão de uso indevido” ou violação de propriedade intelectual.

“Estamos tratando isso como um experimento”, diz Sahai. “É apenas uma certa quantidade de pessoas que podemos monitorar de perto.”

Pessoalmente, estou menos preocupado com a possibilidade de pornografia de vingança de IA, que parece mitigável com proteções suficientes, do que com minha própria falta de consentimento para ser colocado no meme imaginado de outra pessoa. Sugiro que uma abordagem mais responsável, se a OpenAI estivesse focada em fazer a geração humana de forma ética, seria introduzir opções mais rigorosas de aceitação e exclusão.

Com um recurso opcional, os artistas só poderiam gerar vídeos deles mesmos, por exemplo. Ou talvez qualquer um pudesse simplesmente acessar o OpenAI e optar por não ter sua imagem usada. A opção hipotética de optar pela exclusão seria logisticamente complicada, pois exigiria que a OpenAI estudasse cada rosto que entra em seu sistema.

“Isto é algo que vamos considerar”, diz Sahai sobre a sugestão de ferramentas de exclusão. “Há muita complexidade biométrica se armazenarmos dados e ferramentas faciais além disso, e isso se torna uma barreira tão grande onde. . . é mais fácil simplesmente desligar o recurso.”

O Sora da OpenAI já está disponível. A realidade desapareceu para sempre.